“奶奶,我不小心撞了人,千万别让爸妈知道,你快救救我!”

听到电话那头“孙子”的声音,湖南的刘奶奶慌了神,立即按照对方的指示去银行取了3万元现金,并根据约定在村口将钱亲手交给了“所长亲戚”。

这只是“AI诈骗”的一个案件。在这个数字化浪潮汹涌的时代,AI技术宛如一把双刃剑,在带来便捷与创新的同时,也悄然为老年人埋下了新型风险隐患。随着声音与视频伪造技术的门槛大幅降低,一些黑灰产从业者如同狡猾的猎手,瞄准了老年人对新技术不熟悉、信息获取渠道有限以及情感上容易依赖亲人的弱点,展开了一场步步为营的“围猎”行动。

新京报贝壳财经记者调查发现,这些看似高明的骗术,实则为AI深度伪造技术支撑。针对老年人的AI“陷阱”,主要包括通过深度伪造方式伪装成老人的亲属子女等身份,进行钱款诈骗,以及通过AI伪造医生、专家身份再进行直播卖货。他们通过精心制作的虚假宣传视频和文案,往往夸大产品功效,甚至编造出一些子虚乌有的“治愈案例”,让老人们深信不疑。

新京报贝壳财经记者在多个平台上搜索发现,不少人对换脸/克隆声进行“打包出售”,价格低至1元,这在一定程度上降低了诈骗门槛。而境外平台上的黑灰产从业者也提供从换声到换脸的“一条龙服务”,标价仅十几元至百元不等。

北京盈科(合肥)律师事务所合伙人姜万东在接受新京报贝壳财经记者采访时表示,随着人工智能技术越来越成熟,AI换脸已经没有什么难度,甚至成为一种新的商业模式。但在使用AI换脸时,必须严格遵守法律法规,在未经许可前提下使用他人的照片或者声音素材进行换脸或换声、在网上提供AI换脸或换声服务、教程并收取费用、使用AI合成或换脸假冒权威人士视频等行为,可能侵犯他人肖像权、声音权,甚至构成刑事犯罪。

“孙子惹祸,急需用钱”,AI换声、换脸诈骗盯上养老钱

“家里的老人接到一个电话,打的是老人家里的固话。说是我儿子,据说声音、语气一模一样,而且还说出了自己的名字。因为路上刚才开车撞人了,让老人拿钱帮忙,还以‘不想让爸妈知道’的理由让老人不要告诉我们。”一位网友分享了“假孙子”的诈骗过程,直呼“骗子太可怕了”。

这样的诈骗往往经过精心策划。这名网友经历中,骗子找跑腿小哥前往家里拿钱,老人经劝说和报警后才反应过来。“骗子就是盯上八九十岁的老人对孩子的在意,而且我们的信息暴露得彻彻底底,连孩子都不知道他爷爷的固话号码,骗子把声音和语气用AI模仿得非常逼真。”

贝壳财经记者梳理爆料以及警方案例发现,骗子利用AI换声、换脸冒充亲友实施诈骗的对象多为老年人,套路普遍为用户的隐私信息泄露后,诈骗分子通过AI技术伪造身份,再以类似“孙子惹祸,急需用钱”等理由向亲属、朋友特别是老人进行诈骗。

从事互联网安全的反诈专家吴明(化名)告诉贝壳财经记者,这类诈骗手段的“起点”往往是用户的隐私信息遭到了泄露,“比如有用户在下载未知来源App时给予了手机权限,导致手机的通讯录、照片、短信等数据被上传到了诈骗分子的后台。通过用户泄露或在社交平台公开分享的声音或视频数据,诈骗分子就可以通过AI技术伪造用户的声音,从而进行诈骗。”

10月21日至26日,新京报贝壳财经记者在国内外的交易、社交平台搜索发现,AI换脸、换声相关服务、教程等随处可见。平台上,AI一键替换视频中人物的教程,标价低至1元。这类教程通常提供软件或工作流的下载地址及安装说明,甚至有教程标榜生成图片、视频没有市面主流生成模型那么多限制,并提供“图片去AI化”功能。至于AI声音克隆,标价同样最低可至1元,针对需要现场克隆的声音则“贵20元”。

贝壳财经记者调查看到,不少提供视频和声音制作的黑灰产卖家,并不在意相关视频的用途,只是根据客户需求难度进行明码标价:“换脸换声视频”制作以虚拟币结算,折合人民币463元,只换声音约为228元,且可以“定制话术”。

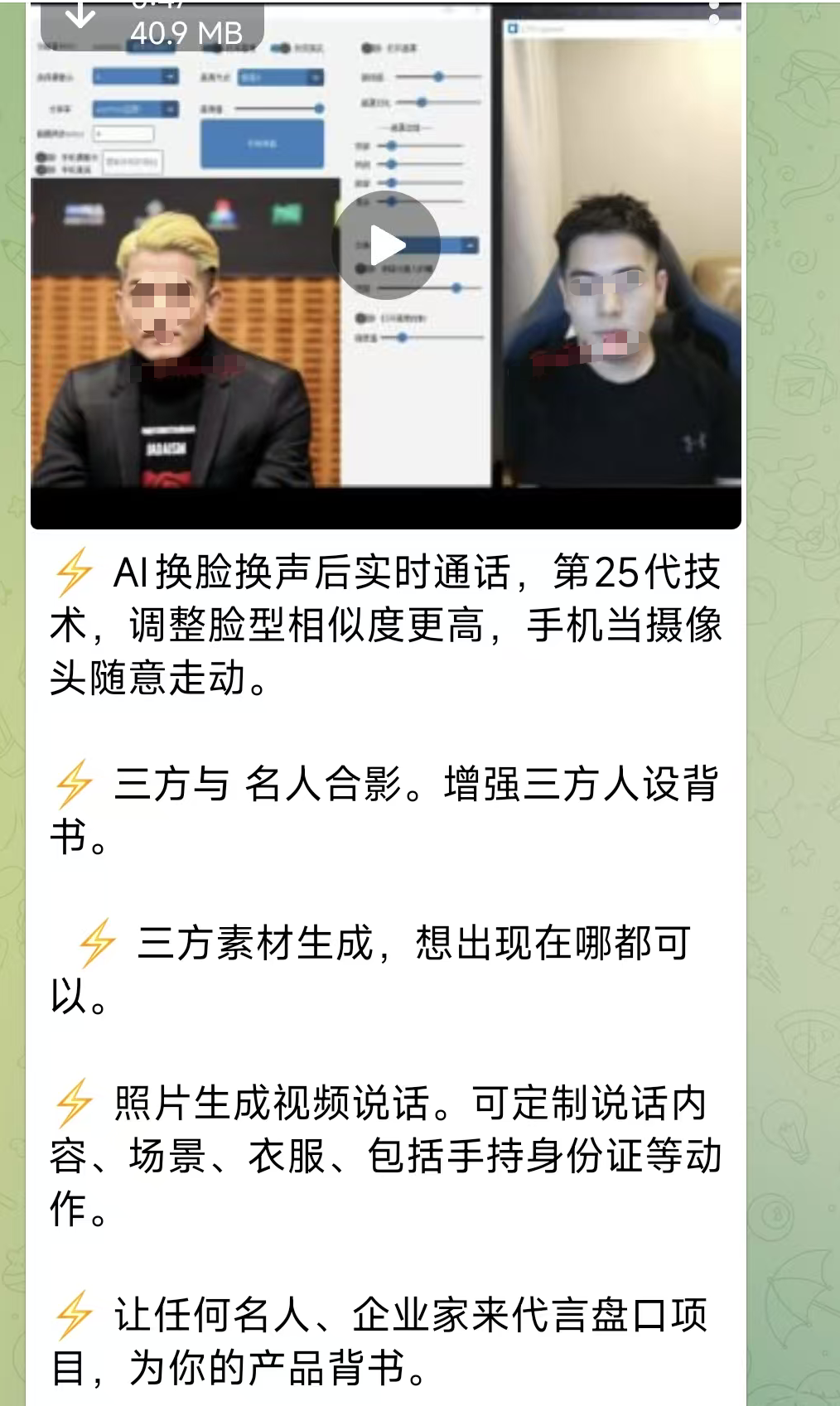

个别黑灰产交易频道上还兜售配合这些技术的专业诈骗软件。“采用我们手机端软件的功能,甚至可以用手机直接拨打视频电话,可配合市面上各种换脸软件,让你的‘客户’找不到破绽,你还可以拿手机随便走动。”有黑灰产卖家表示。

黑灰产卖家宣传信息。截图

“假专家”出没带货,80元可定制明星“代言视频”

不少AI克隆服务或教程卖家的目标客户,主要是为了冒充名人直播卖货或对产品进行背书。此前,靳东、雷军、张文宏等均被AI造假。

为了增加相关产品的可信度,一些卖家晒出了包括郭富城、巩俐、齐秦等明星为一些公司或产品发表的“代言视频”或“祝福视频”,其中一些视频涉及的公司和产品指向金融诈骗。

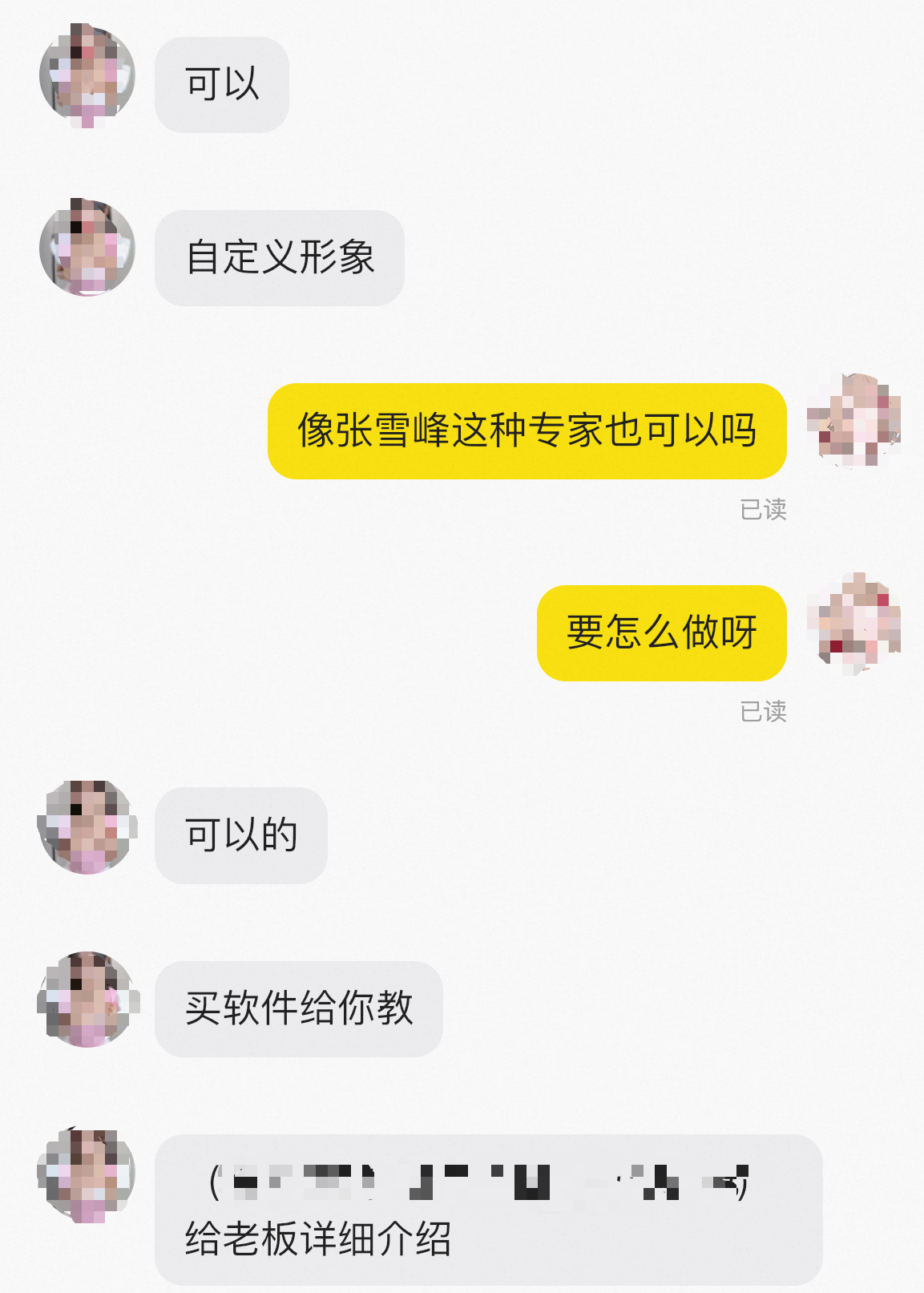

贝壳财经记者以买家身份咨询了解到,AI视频制作服务80元起步。有提供AI数字人制作软件的商家称,购买软件可以教操作方法,明星以及张雪峰等人都可以生成。根据该商家提供的资料,购买该软件月卡188元,永久版288元。

交易平台上,卖家宣称可以自定义形象。截图

实际上,随着技术的进步和开源,声音克隆的门槛并不高。贝壳财经记者在一个开源软件中上传了一段3分钟的本人录音,训练出了声音模型,虽然效果在生成长语句时偶有瑕疵,但对于一些较短的语句来说,几乎识别不出为合成的语音。

这一开源软件的作者也在使用界面中标注,“本软件以MIT协议开源,作者不对软件具备任何控制力,使用软件者、传播软件导出的声音者自负全责。”

10月24日,一视频平台相关负责人告诉贝壳财经记者,利用AI技术进行虚假宣传已成为互联网广告安全治理的重要挑战。为保障用户权益,平台制定严格的管控规则,如要求广告内容中不得含有虚构人设,不得自称或描述存在某某身份/姓名/职位人设,为产品或服务做背书。若发现违规问题,将对广告主采取限制投放、封禁账户甚至清退等处置。

10月26日,中国人民大学人口与发展研究中心召开“数字时代老年人短视频使用与网络安全”研讨会,并联合抖音发布《老年人短视频健康使用指南》,涵盖了几类短视频平台上的典型欺诈案例,其中一类新型骗局是利用 AI 技术伪造老年人信任的身份,如名人、企业家、公职人员,或杜撰与养老金发放、家人健康、子女运势等相关的信息,诱导老年人点赞、关注、转发。一旦这些账号借“情感钓鱼”积累了真实用户互动,便被包装成“优质账号”,进而用于账号倒卖或参与黑灰产业活动牟利。

“使用AI合成‘假专家’或权威人士进行带货或直播带货的行为可能触及多项法律法规。根据《中华人民共和国民法典》,侵犯肖像权、声音权,需承担停止侵权、赔偿损失等责任;根据《中华人民共和国消费者权益保护法》,构成欺诈的,消费者可要求‘退一赔三’;根据《中华人民共和国刑法》,若涉及诈骗、虚假宣传等情节严重的行为,可能构成诈骗罪、虚假广告罪等。总之,使用AI技术时,需严格遵守法律法规,取得授权并确保内容合法合规。”姜万东告诉记者。

走出“定向”诈骗,深度伪造与检测技术正相互博弈

贝壳财经记者采访基层民警、反诈专家、平台监管部门了解到,通过伪造老人亲属身份进行“定向”诈骗,诈骗流程相对烦琐、成本更高,虽然个案金额往往较大,但总体来看案件数量不及刷单、投资等诈骗案例多。

另一方面,随着AIGC标识新规的出台以及视频平台对用户身份核验流程的完善、对AI欺诈行为的打击,AI冒充“假专家”也会更加困难。

9月1日,国家互联网信息办公室等四部门联合发布的《人工智能生成合成内容标识办法》施行,其中要求在相关平台上上传的视频内容,若使用AI制作的需添加标识。这将让一些“冒充专家”的AI视频失去传播空间。

如今,平台能否检测出视频为AI生成正成为一大挑战。中国信通院人工智能研究中心安全与元宇宙部主任石霖告诉贝壳财经记者,目前深度伪造技术与检测技术正在相互博弈,“它们就像杀毒与造毒一样,是长期攻防对抗的过程。现在来看,伪造的技术也确实越来越真实有效,我们从调研中发现,检测技术在一定程度上可能有一定滞后性,对于新的算法需要样本积累和过滤。”

针对“假孙子”“假专家”类骗局,海淀金融管理局发文称,老年人应提高警惕,采取防范措施:在接到陌生来电或视频通话时,要仔细核实对方身份。可以通过拨打亲友的常用电话、视频通话中询问一些私密问题等方式进行验证;不要轻易将个人信息、银行账户、密码等敏感信息透露给陌生人。同时,要定期更换密码、开启双重验证等安全措施;对于任何承诺高收益的投资或医疗产品,都要保持警惕。记住“天上不会掉馅饼”,高收益往往伴随着高风险。

“数字时代老年人短视频使用与网络安全”研讨会的与会专家一致认为,应对风险需多管齐下,既需从老年人自身层面提升反诈意识、了解数字技术,也需从家庭层面、社会支持层面为老年人提供心理与技术双重支持。

“老年人只有先知道AI生成技术,才能有识别AI虚拟人物的意识,从而规避不法分子利用AI虚拟形象制造的骗局。”北京东方老年研修学院院长、北京市石景山区老年大学原校长杨文霞鼓励老年人勇于接触网络、保持终身学习。

中国人民大学人口与健康学院教授唐丹认为,家庭仍是帮助老年人防范网络风险的第一道防线,但构建家庭防线需细水长流,不能急于求成,只要老人的短视频使用行为未对其身心健康造成实质伤害,子女就应当给老人保留自由探索的空间,并在日常交流中适时进行风险提示和技能科普。

新京报贝壳财经记者 罗亦丹 韦英姿

编辑 王进雨

校对 柳宝庆